Re: [線代] QR分解的意義

最近又重新在研究解最小平方法的數值方法,

在數學上解最小平方法做回歸分析是解反矩陣,

但是反矩陣在數值計算上誤差會從算 (A^T)A 開始累積,

然後雖然用 Scaled-pivot 的 LU 分解可以得到不錯的數值穩定性,

但是 LU 分解沒有辦法避免病態條件(ill-conditioned),

QR 分解可以解決這個問題,因 QR 分解是直接分解 A = QR。

而 QR 分解有三種算法:

1. (modified) Gram-Schmit (MGS)

這個方法在有兩向量是幾乎平行的時候會產生較大數值誤差

2. Householder

適用於 dense matrix(矩陣中有較多的非零元素)

3. Given

適用於 sparse matrix(矩陣中有較多的零元素)

後兩者在數值穩定上勝過 MGS 與 LU [1]。

雖然 LU 分解這步驟的計算資源少於 QR Householder(QRH),

但是通常在做回歸時所得到的 A 矩陣不是方陣,故一般來說 QRH 會是最佳的方法。

而 rank-deficient 矩陣解迴歸分析又是另一個算法了。

[1] Matrix Analysis & Applied Linear Algebra, P349

好啦我想問一下 QR 分解中所使用到的 WY 表示,我看了很多資料還是不知道怎麼來的。

--

!!!!!!!!!!!!!!簽名檔破3000000點擊率啦!!!!!!!!!!!!!

Fw: [問卦] 電影:決勝21點的機率問題 https://bit.ly/2TlnFhC #1MfN3FgZ (joke)

→

07/22 16:41,

07/22 16:41

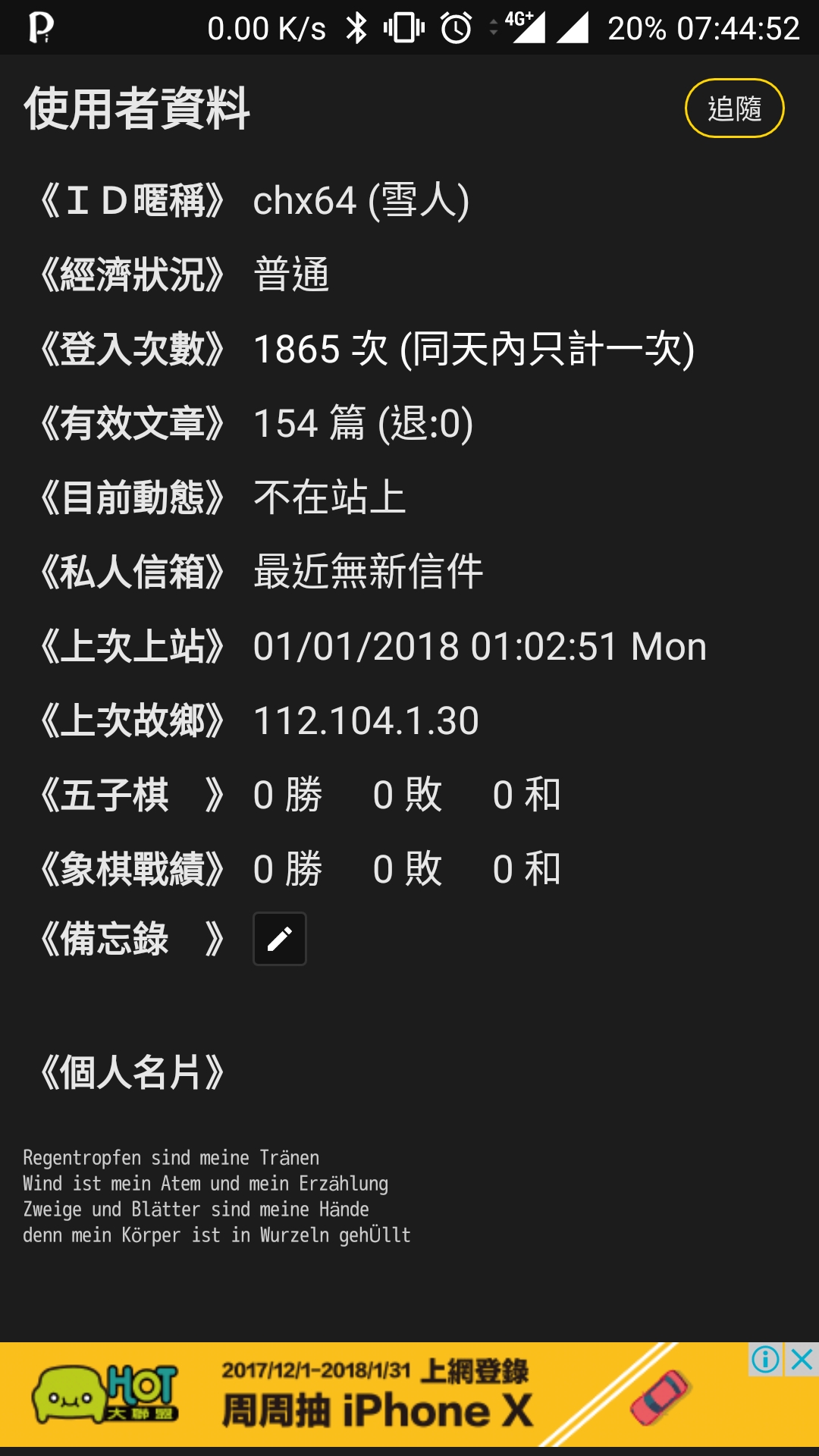

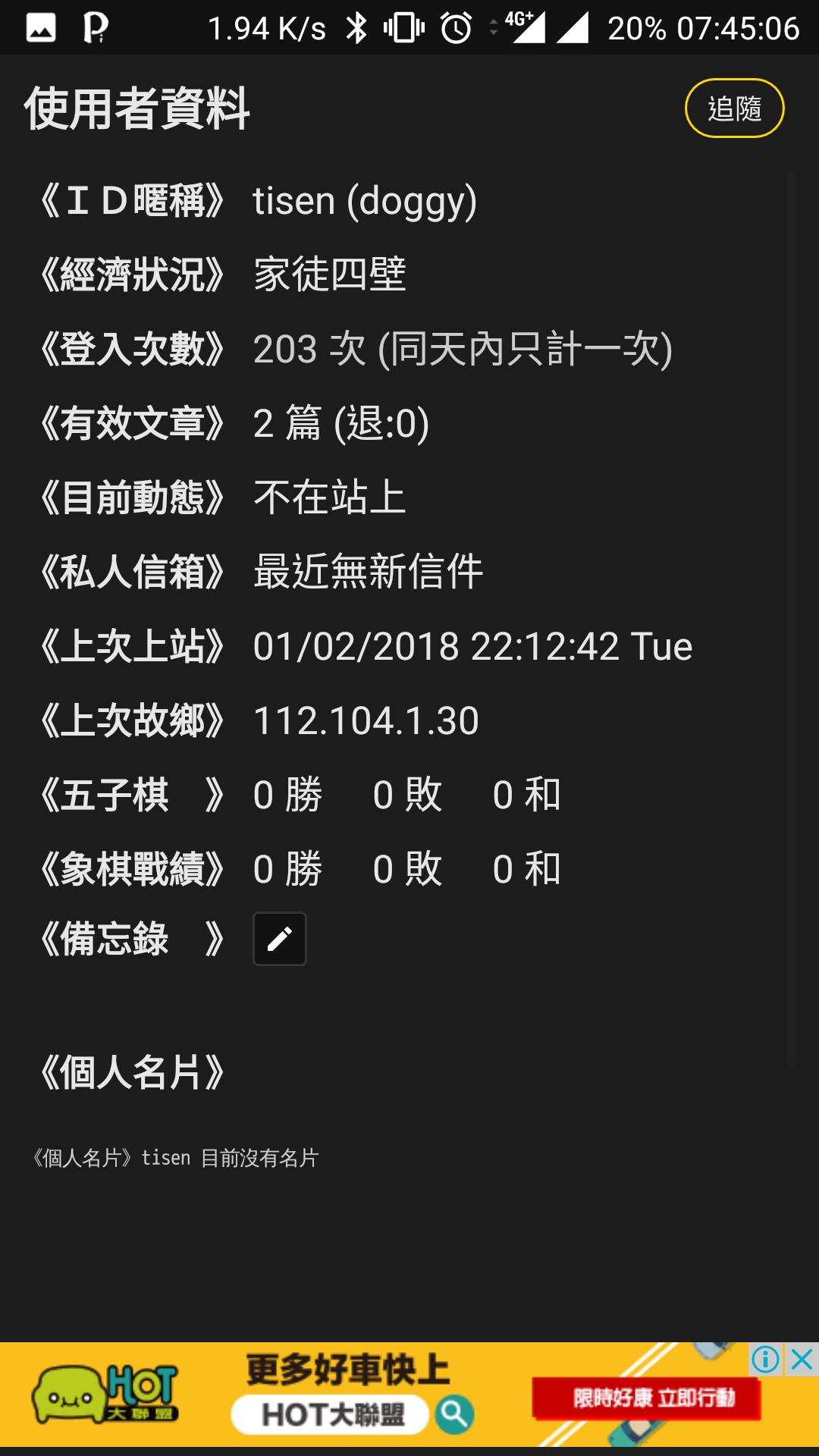

chx64註冊tisen這帳號是想幹嘛啊?哈哈哈

--

※ 發信站: 批踢踢實業坊(ptt.cc), 來自: 39.9.175.39 (臺灣)

※ 文章網址: https://www.ptt.cc/bbs/Math/M.1618025055.A.37E.html

討論串 (同標題文章)

完整討論串 (本文為第 2 之 2 篇):

線代

3

7