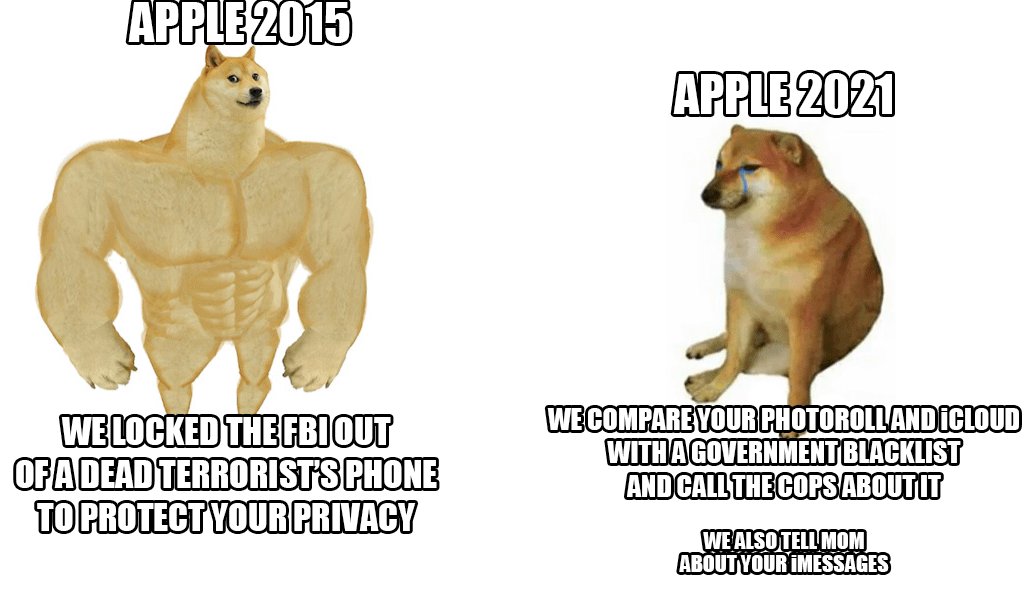

[情報] 蘋果新的照片審查機制

請問蘋果利用iCloud 來檢查iPhone 使用者是否

持有兒童暴力相關照片(性暴力或是虐待),這樣不會違反他們的初衷嗎? 蘋果一直以來都給人一種顧客隱私終於一切的感覺,而且這個審查機制難保不會無限上綱到別的領域,例如手機偷拍或是一些外流影片等等。此外文中有提到這個技術不是掃描整台手機,而是他們有個資料庫會自動配對兒童暴力的照片,但我是滿好奇在技術上是怎麼做到這點的XD

原文:https://edition.cnn.com/2021/08/05/tech/apple-photos-child-abuse-imagery/index.html?utm_content=2021-08-06T00%3A31%3A14&utm_source=fbCNN&utm_medium=social&utm_term=link&fbclid=IwAR3WKxVEgloYfpoyR38IhbDL92tv9hia7J_fRKjCgNo5Fr5GNA24G4AuwlY

-----

Sent from JPTT on my iPhone

--

※ 發信站: 批踢踢實業坊(ptt.cc), 來自: 101.137.219.141 (臺灣)

※ 文章網址: https://www.ptt.cc/bbs/iOS/M.1628214149.A.796.html

推

08/06 09:43,

4年前

, 1F

08/06 09:43, 1F

推

08/06 09:45,

4年前

, 2F

08/06 09:45, 2F

推

08/06 09:48,

4年前

, 3F

08/06 09:48, 3F

→

08/06 09:51,

4年前

, 4F

08/06 09:51, 4F

→

08/06 09:51,

4年前

, 5F

08/06 09:51, 5F

推

08/06 10:09,

4年前

, 6F

08/06 10:09, 6F

推

08/06 10:31,

4年前

, 7F

08/06 10:31, 7F

→

08/06 10:47,

4年前

, 8F

08/06 10:47, 8F

→

08/06 10:47,

4年前

, 9F

08/06 10:47, 9F

→

08/06 10:48,

4年前

, 10F

08/06 10:48, 10F

→

08/06 11:01,

4年前

, 11F

08/06 11:01, 11F

推

08/06 11:47,

4年前

, 12F

08/06 11:47, 12F

→

08/06 11:47,

4年前

, 13F

08/06 11:47, 13F

→

08/06 11:47,

4年前

, 14F

08/06 11:47, 14F

→

08/06 11:47,

4年前

, 15F

08/06 11:47, 15F

→

08/06 11:47,

4年前

, 16F

08/06 11:47, 16F

→

08/06 11:47,

4年前

, 17F

08/06 11:47, 17F

→

08/06 11:47,

4年前

, 18F

08/06 11:47, 18F

推

08/06 11:52,

4年前

, 19F

08/06 11:52, 19F

推

08/06 11:54,

4年前

, 20F

08/06 11:54, 20F

→

08/06 11:54,

4年前

, 21F

08/06 11:54, 21F

→

08/06 11:54,

4年前

, 22F

08/06 11:54, 22F

推

08/06 11:54,

4年前

, 23F

08/06 11:54, 23F

→

08/06 12:33,

4年前

, 24F

08/06 12:33, 24F

→

08/06 12:38,

4年前

, 25F

08/06 12:38, 25F

推

08/06 15:41,

4年前

, 26F

08/06 15:41, 26F

→

08/06 15:41,

4年前

, 27F

08/06 15:41, 27F

→

08/06 16:17,

4年前

, 28F

08/06 16:17, 28F

推

08/06 17:18,

4年前

, 29F

08/06 17:18, 29F

→

08/06 18:27,

4年前

, 30F

08/06 18:27, 30F

推

08/06 18:34,

4年前

, 31F

08/06 18:34, 31F

推

08/06 18:47,

4年前

, 32F

08/06 18:47, 32F

推

08/06 19:21,

4年前

, 33F

08/06 19:21, 33F

推

08/06 21:42,

4年前

, 34F

08/06 21:42, 34F

推

08/06 21:56,

4年前

, 35F

08/06 21:56, 35F

推

08/06 22:20,

4年前

, 36F

08/06 22:20, 36F

→

08/06 22:41,

4年前

, 37F

08/06 22:41, 37F

推

08/06 23:45,

4年前

, 38F

08/06 23:45, 38F

→

08/06 23:45,

4年前

, 39F

08/06 23:45, 39F

→

08/06 23:45,

4年前

, 40F

08/06 23:45, 40F

→

08/06 23:45,

4年前

, 41F

08/06 23:45, 41F

→

08/06 23:45,

4年前

, 42F

08/06 23:45, 42F

→

08/06 23:45,

4年前

, 43F

08/06 23:45, 43F

→

08/06 23:45,

4年前

, 44F

08/06 23:45, 44F

推

08/07 00:53,

4年前

, 45F

08/07 00:53, 45F

噓

08/07 06:14,

4年前

, 46F

08/07 06:14, 46F

推

08/07 07:54,

4年前

, 47F

08/07 07:54, 47F

→

08/07 07:54,

4年前

, 48F

08/07 07:54, 48F

推

08/09 05:33,

4年前

, 49F

08/09 05:33, 49F

→

08/09 05:43,

4年前

, 50F

08/09 05:43, 50F

→

08/09 05:43,

4年前

, 51F

08/09 05:43, 51F

推

08/11 09:28, , 52F

08/11 09:28, 52F

討論串 (同標題文章)